논문명: Position: Current Model Cards Are Insufficient for Downstream Governance of Open-Weight Foundation Models

저자: Sungwon Chae, Keonwoo Kim, Hoki Kim, Jaeyeon Ju, Sangchul Park

게재지: ICML 2026

서론

생성형 인공지능과 파운데이션 모델(Foundation Model)의 확산은 기술 그 자체의 문제를 넘어, 거버넌스(Governance)라는 사회·법·정책적 과제로 우리에게 다가오고 있습니다. 특히 가중치(weights)가 공개되는 오픈웨이트 파운데이션 모델(Open-Weight Foundation Models, OWFMs)은 개방성과 재현성이라는 미덕을 제공하는 반면, 일단 공개되면 누구나 다운로드·재배포·미세조정·증류할 수 있다는 점에서 다운스트림(downstream) 책임 추적이 본질적으로 어렵습니다.

지난 5년간 이러한 문제의 주된 해결책으로 자리 잡은 것이 모델 카드(Model Card; Mitchell et al. 2019)입니다. 모델 카드는 모델의 의도된 사용처, 평가 결과, 한계, 윤리적 고려 사항을 표준화된 문서로 정리한 것으로, 투명성(transparency)의 사실상의(de facto) 표준이 되었습니다. 그러나 본 논문이 제기하는 핵심 질문은 다음과 같습니다.

“OWFM 개발자들은 다운스트림 거버넌스를 실제로 어떻게 운영하고 있는가? 어떤 한계가 존재하며, 어떻게 개선되어야 하는가?”

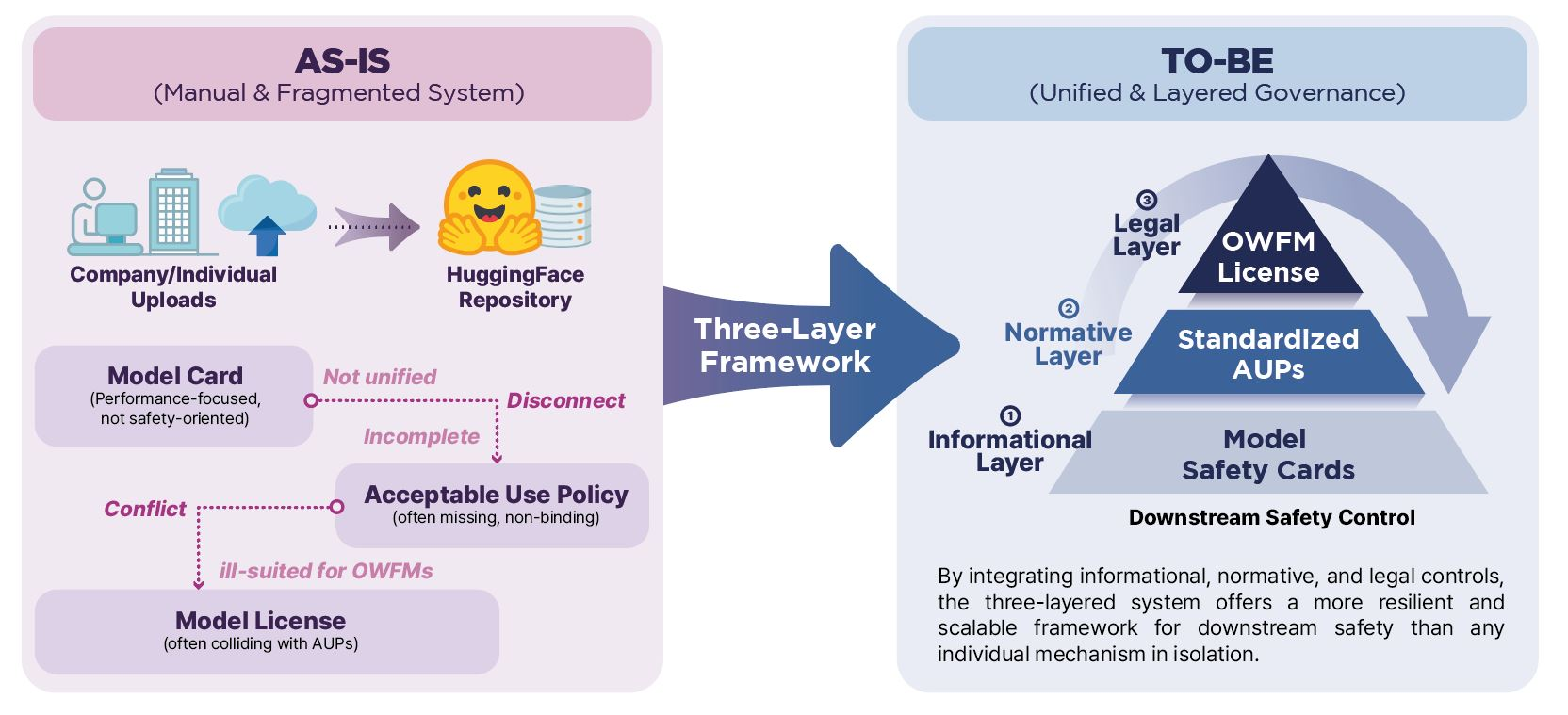

“Position: Current Model Cards Are Insufficient for Downstream Governance of Open-Weight Foundation Models”는 본 연구실이 ICML 2026에 채택된 포지션 논문으로, 모델 카드가 단독으로는 다운스트림 거버넌스를 담보할 수 없음을 실증 데이터로 보이고, 정보(Informational) · 규범(Normative) · 법(Legal)의 세 층(layer)을 통합하는 새로운 거버넌스 프레임워크를 제안합니다. 본 글에서는 OWFM 거버넌스의 현주소와 본 논문의 처방을 차근차근 살펴보고자 합니다.

사전 지식

모델 카드(Model Card)

모델 카드는 인공지능 모델의 사양(specification)을 문서화한 표준 양식입니다. 의도된 용도(intended use), 학습 데이터, 평가 지표, 알려진 한계, 윤리적 고려, 환경 영향 등을 포함하도록 권고됩니다. Mitchell et al. (2019)이 제안한 이래 Hugging Face·Kaggle·TensorFlow Hub 등 주요 모델 허브의 표준 메타데이터로 자리 잡았으며, 본 논문이 표적으로 삼는 정보(Informational) 거버넌스의 핵심 도구입니다.

Acceptable Use Policy (AUP)

Acceptable Use Policy(AUP)는 모델의 허용 가능한 사용 범위를 규정하는 규범 문서입니다. 예를 들어 Meta의 Llama 3 AUP는 군사 용도, 무기 개발, 미성년자 착취, 차별·차별 조장, 위·변조 등을 명시적으로 금지합니다. AUP는 OSI 인증 라이선스가 표방하는 사용 자유와 정면으로 충돌할 수 있다는 점에서 규범(Normative) 거버넌스의 핵심 축으로 기능합니다.

모델 라이선스(Model License)

모델 가중치 또한 일종의 산출물(artifact)이므로 라이선스 부여가 가능합니다. 다만 전통적 오픈소스 라이선스(Open-Source License, OSL — 예: Apache 2.0, MIT, BSD)는 소스 코드(source code)와 객체 코드(object code)라는 소프트웨어 산출물을 전제로 설계되었습니다. 모델 가중치는 코드도 아니고 학습 데이터도 아닌 학습된 파라미터라는 새로운 객체이며, 그 저작권 적격성(copyrightability) 자체가 법학적으로 모호합니다. 또한 모델은 출력(output), 미세조정 산출물(fine-tuned weights), 증류 산출물(distilled weights)과 같은 2차 산출물(derivative work)을 무수히 생산하는데, 기존 OSL은 이를 명시적으로 다루지 않습니다.

본론

Hugging Face 500개 모델 실증 분석

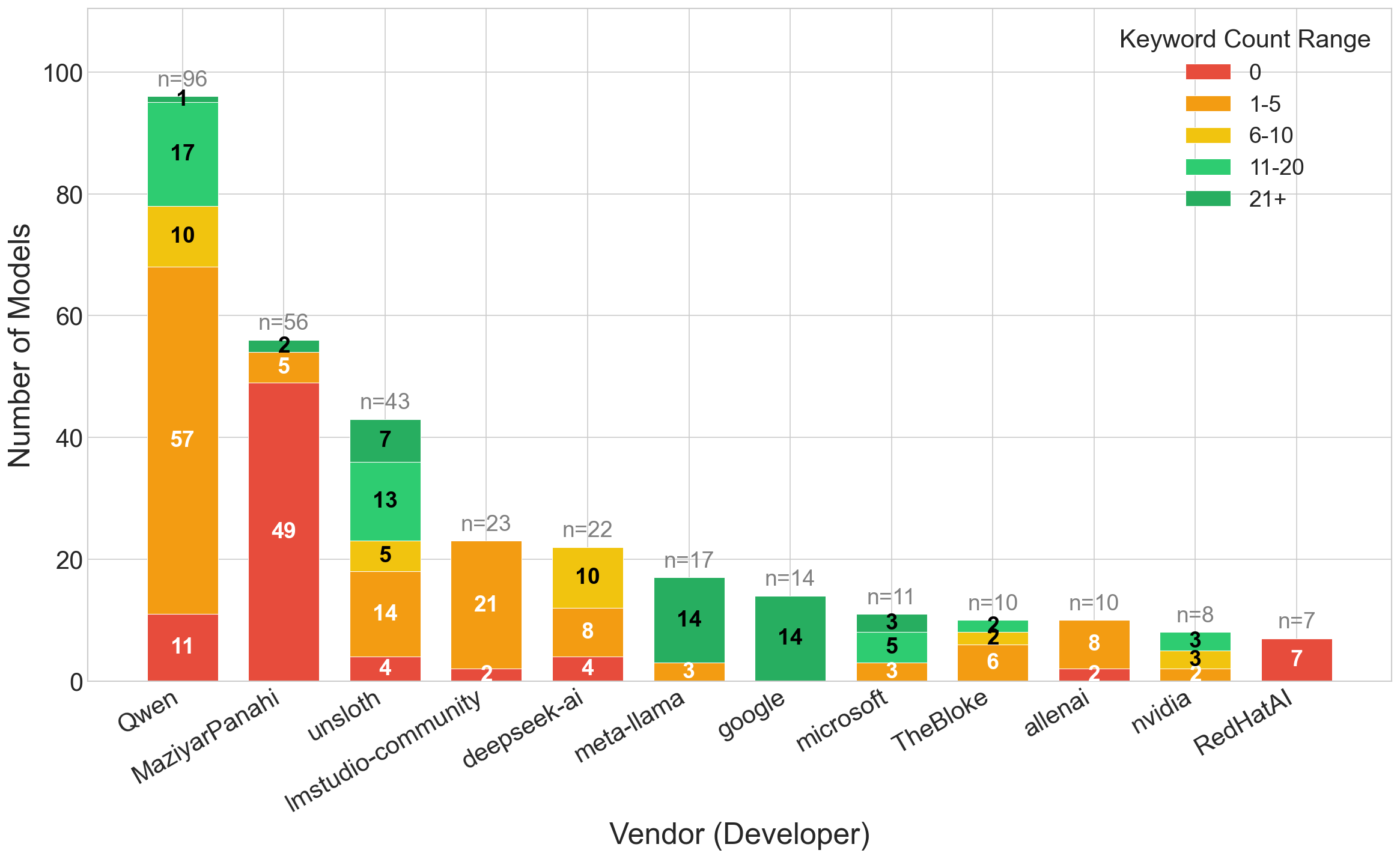

본 논문은 2026년 1월 11일 기준 Hugging Face의 다운로드 수 상위 500개 모델을 대상으로 거버넌스 산출물(governance artifact)의 존재 여부를 정량 조사하였습니다. 결과는 다음과 같습니다.

| 거버넌스 산출물 | 보유 모델 수 | 비율 |

|---|---|---|

| 모델 카드(Model Card) | 464 | 92.8% |

| 안전 관련 필드(Safety-specific fields) | 366 | 73.2% |

| Acceptable Use Policy (AUP) | 55 | 11.0% |

| 명시적 라이선스(Explicit License) | 403 | 80.6% |

| 세 산출물 모두 보유(All three artifacts) | 55 | 11.0% |

이 표가 보여주는 함의는 명확합니다. 모델 카드는 사실상 모든 인기 모델이 갖추고 있지만, 법적 강제력의 핵심 요소인 AUP는 단 11.0%만이 명시하고 있으며, 정보·규범·법 세 산출물을 모두 갖춘 모델 역시 단 11.0%에 불과합니다. 투명성은 외형상 충족되어 있으나, 집행 가능성(enforceability)은 사실상 부재한 상태입니다.

네 가지 구조적 결함

분석 결과에 기반하여 본 논문은 네 가지 결함을 규명합니다.

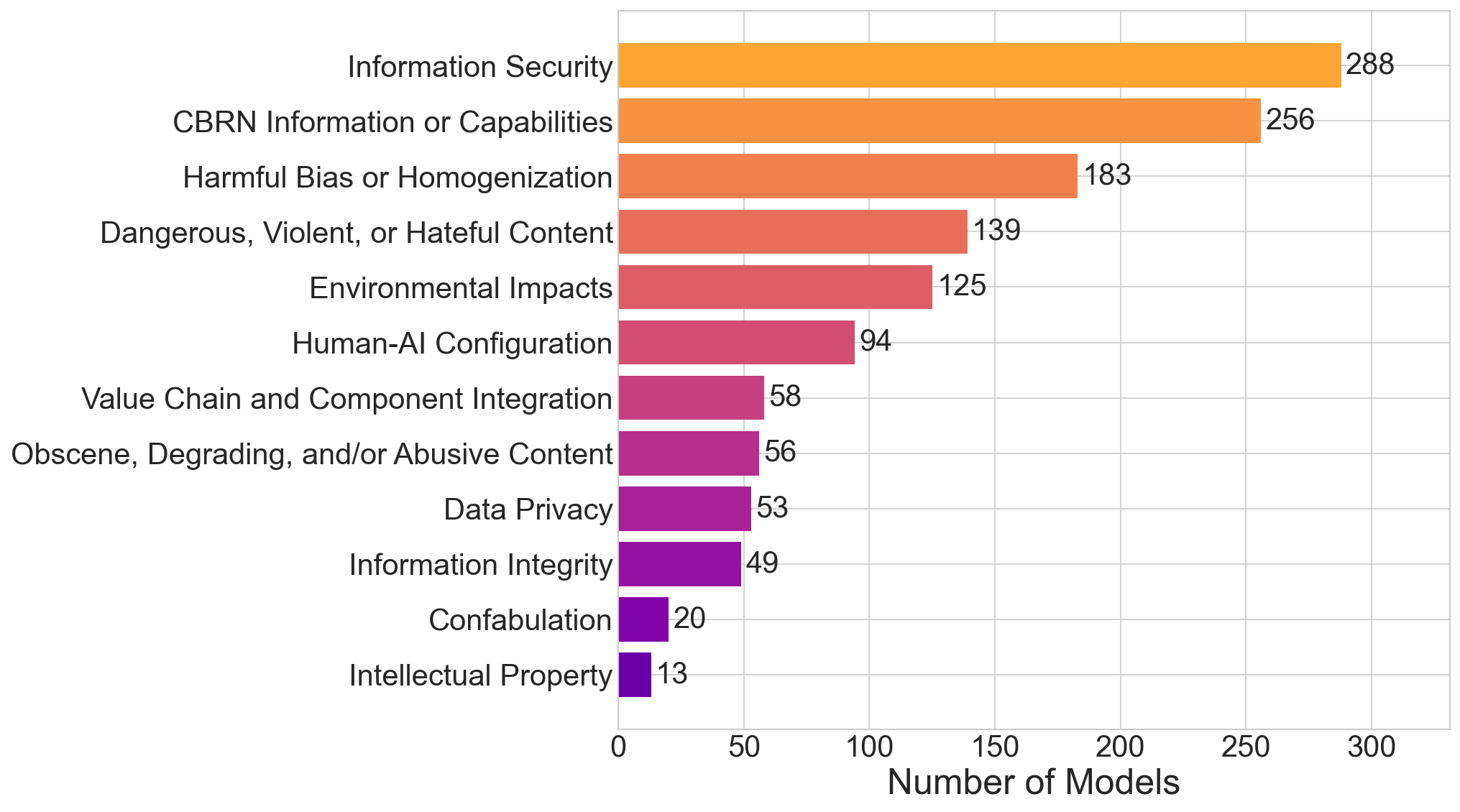

1. 광범위한 불완전성(Pervasive Incompleteness). 안전 관련 정보가 별도 필드가 아닌 일반 README 본문에 산재하여, 자동 감사(audit)·집계(aggregation)·정책 매핑이 불가능합니다. 키워드 카운트가 높더라도 이는 서술의 양이지 정형 정보(structured data)가 아닙니다.

2. AUP의 부재(AUPs Largely Absent). 11.0%만이 AUP를 명시한다는 사실은, 허용되지 않는 사용을 다운스트림 사용자에게 강제할 수단이 사실상 없다는 것을 의미합니다.

3. 라이선스 충돌(Licensing Conflicts). 9.8%의 모델은 Apache 2.0과 같은 허용적(permissive) OSL 위에 AUP 스타일의 제약적(use-based) 조항을 덧붙입니다. OSL의 광범위한 권리 부여는 사용 목적에 따른 차별을 거의 허용하지 않으므로, 두 문서는 법적으로 충돌하거나 허용 외(non-permitted) 영역을 만듭니다.

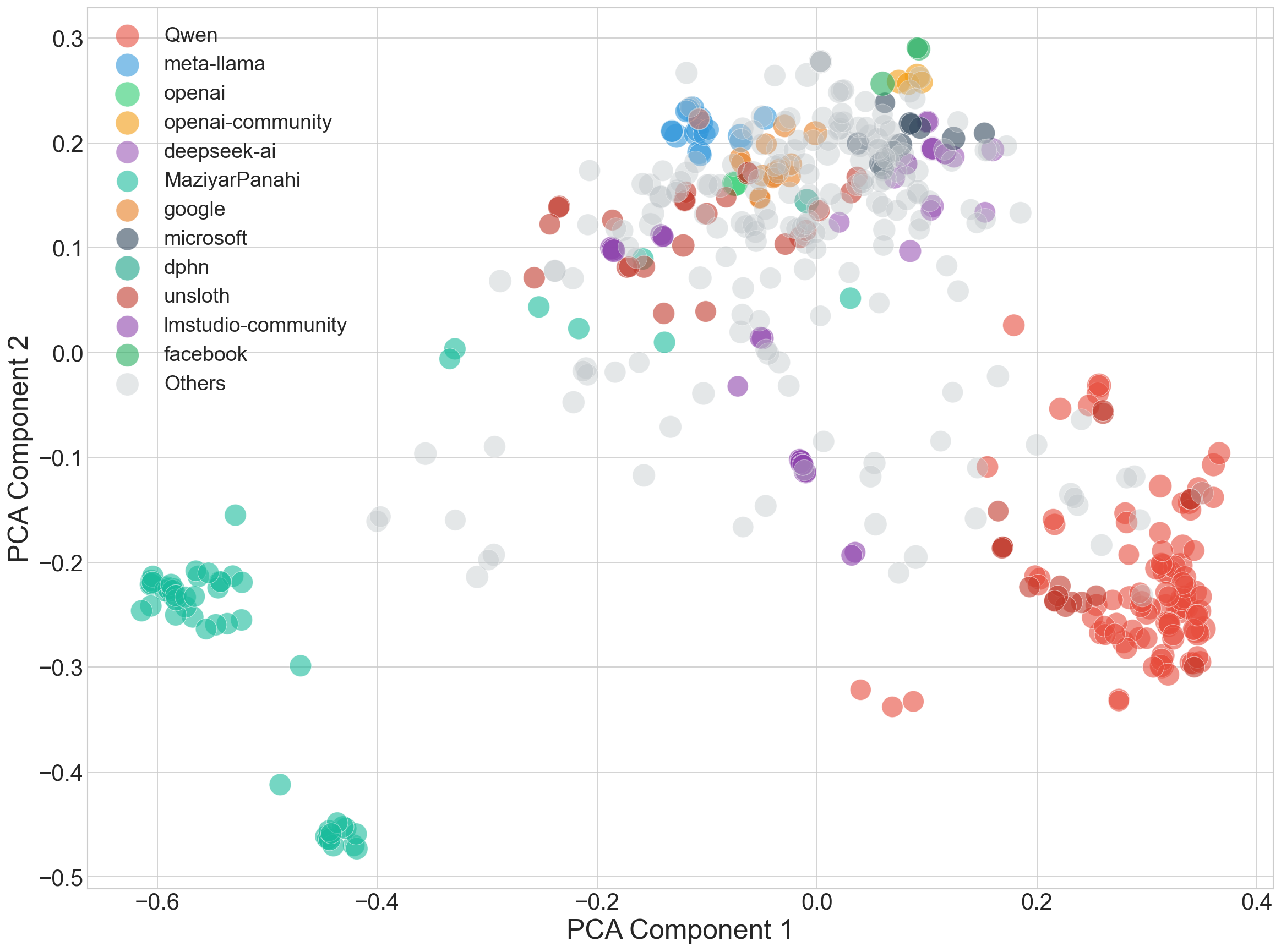

4. 구조적 단절(Structural Fragmentation). 안전 필드를 보유한 모델 중에서도 라이선스와 정합적으로 연동된 비율은 62.2%에 그칩니다. 즉, 정보 거버넌스와 법적 거버넌스가 서로 다른 문서·다른 어휘·다른 책임 주체에 분산되어, 다운스트림 사용자는 어느 문서를 따라야 하는지 일관되게 판단할 수 없습니다.

모델 카드의 구조적 한계

본 논문은 이러한 실증 결과가 단순한 준수율(compliance) 문제가 아니라 모델 카드라는 도구 자체의 구조적 한계에서 기인한다고 봅니다.

비-운영적 안전 주장(Non-operational Safety Claims). “본 모델은 차별적 출력을 줄이도록 학습되었습니다”와 같은 서술은 다운스트림 감사자가 검증할 수 있는 형태가 아닙니다. 평가 데이터셋·임계값·실패 사례 등 운영 가능한 형태로 기술되지 않으면, 사실상 마케팅 진술에 머무릅니다.

유래·영향 정보 누락(Missing Provenance / Influence Disclosure). 학습 데이터의 출처(provenance), 사용된 정렬 데이터(alignment data), 안전 미세조정의 강도와 범위에 대한 정보가 누락되면, 다운스트림 사용자는 자신이 사용하는 모델이 어떤 정렬 가정(alignment assumption)을 내포하는지 알 수 없습니다.

오픈소스 라이선스(OSL)와 AUP의 충돌

법학적 측면에서도 OSL은 OWFM에 그대로 적용되기 어렵습니다.

저작권 적격성의 모호성(Copyrightability Ambiguity). Apache 2.0은 저작권 보호 대상 산출물(소프트웨어)을 전제하지만, 모델 가중치 자체가 저작권 보호의 대상이 되는지에 대해서는 미국·EU·한국 모두 합의가 부재합니다.

파생 산출물의 경계(Derivative Work Boundaries). 미세조정 산출물, LoRA 어댑터, 증류 산출물, 양자화(quantization) 산출물은 모두 원본의 변형이지만, 그 어디까지가 동일 라이선스의 의무를 승계하는 파생물인지 OSL은 정의하지 못합니다.

학습 데이터에 대한 권리(Rights over Training Data). 학습 데이터에 대한 권리·저작권 침해 책임이 모델 가중치 라이선스에 어떻게 승계되는지 OSL은 침묵합니다.

AUP와의 충돌(Conflict with AUPs). Apache 2.0의 broad grant는 사용 목적에 따른 제한을 거의 허용하지 않습니다. 따라서 Apache 2.0 위에 AUP를 부착하면 법적 효력이 약화되거나, OSI 정의상의 “오픈소스” 자격을 상실합니다.

제안: 3-Layer Governance Framework

이러한 한계를 동시에 해소하기 위해 본 논문은 세 층(layer)을 통합한 거버넌스 프레임워크를 제시합니다(서두 그림의 TO-BE).

Informational Layer — 표준화된 Safety Card. 모델 카드를 단순한 README가 아니라 기계 판독 가능한 정형 문서로 개혁합니다. 핵심 원칙은 (1) 유래 투명성(heritage transparency) — 학습 데이터·기반 모델·정렬 절차의 출처 명시, (2) 정렬 유래(alignment provenance) — 어떤 안전 데이터로, 어느 단계에서, 어떤 강도로 정렬했는지의 명시, (3) 운영 가능 안전 평가(operational safety evaluation) — 평가 데이터셋·임계값·실패 사례의 정량적 보고. 본 논문은 부속서(Appendix IV)에 전체 Safety Card 템플릿을 제공합니다.

Normative Layer — 표준 AUP. AUP를 모델별로 자유 작성하는 현 관행 대신, 표준화된 AUP 템플릿을 도입합니다. 라이선스 본문에 통합되는 형태(Llama 3 AUP, Gemma TOU, OpenRAIL-M)와 별도 문서로 결합되는 형태(GPT-oss, Qwen Usage Policy)를 모두 수용하되, 금지 카테고리(prohibited categories)에 대한 공통 어휘를 정합니다.

Legal Layer — OWFM 전용 라이선스. Apache 2.0을 OWFM에 맞게 변형한 라이선스를 제안합니다. 변경 핵심은 (a) Source/Object/Work 개념을 Model/Output으로 대체, (b) 저작권 고지(copyright notice)를 모델 카드 안으로 이동, (c) 학습·증류·출력에 대한 확장된 권리 부여(expanded grant for outputs), (d) AUP를 부속서(exhibit)로 본문에 결합, (e) 학습 데이터 절(dedicated training-data section) 추가입니다.

반론에 대한 응답

본 논문은 자체 제안에 대한 세 가지 주요 반론에도 응답합니다.

위축 효과와 비용(Chilling Effect & Cost; §4.1). 표준화된 거버넌스가 소규모 개발자에게 부담을 지운다는 우려에 대해, 모델 허브 차원의 공통 템플릿 제공과 자동화 도구를 통해 한계 비용을 낮출 수 있음을 보입니다.

자기 보고 편향과 안전세탁(Self-Reporting Bias / Safetywashing; §4.2). 자가 작성 카드의 신뢰성 부족 문제는 커뮤니티 모니터링과 플랫폼 차원의 검증 절차로 보완해야 합니다.

집행 난점(Enforcement Challenges; §4.3). 다운스트림 행위에 대한 직접 집행이 어렵다는 점은 사전적(ex-ante) 마찰 추가, 평판 메커니즘, 플랫폼 차원의 제재(takedown, throttling) 등 다층적 장치의 결합으로 해소합니다.

결론

오픈웨이트 파운데이션 모델은 인공지능의 개방성과 진보를 견인해 왔지만, 동시에 다운스트림 책임 추적이라는 새로운 정책 과제를 만들어냈습니다. 모델 카드는 투명성의 토대를 제공했지만, 거버넌스의 종착지는 아닙니다. 본 논문은 Hugging Face 500개 모델의 실증 분석을 통해 현행 모델 카드 체제의 네 가지 결함을 정량적으로 보였고, 이를 해소하기 위한 3-Layer Governance Framework와 OWFM 전용 라이선스를 제시하였습니다.

본 논문이 의의가 있는 지점은 단순히 “더 나은 모델 카드”를 요구하는 것이 아니라, 정보·규범·법의 세 층을 동시에 운영해야 다운스트림 거버넌스가 실효성을 가진다는 통합적 처방을 제시한다는 점입니다. 정책·법·기술의 융합이 본격화되는 인공지능 시대에, 본 연구가 OWFM 생태계의 책임 있는 발전에 기여하기를 바랍니다.